Humanidades

Autores de livro sobre IA em sala de aula afirmam que a perda de conhecimento fundamental é a maior ameaça

Os pesquisadores observaram que os educadores estão preocupados com a dependência excessiva dos alunos em relação à IA e seu possível impacto no pensamento crítico, na resolução de problemas e nos relacionamentos.

Crédito: Unsplash/CC0 Domínio Público

Especialistas afirmaram na quinta-feira, durante um debate patrocinado pela Harvard Education Press, que os educadores devem ensinar os alunos a usar ferramentas de IA, mas com ênfase na ética, no impacto social e nos potenciais vieses da tecnologia.

Stephanie Smith Budhai e Marie Heath, coautoras de "Inteligência Artificial Crítica em Salas de Aula do Ensino Fundamental e Médio", disseram a Teddy Svoronos, professor sênior de políticas públicas da Kennedy School, que o uso responsável da IA exige uma dose saudável de ceticismo. Em outras palavras: resista ao entusiasmo exagerado fazendo perguntas difíceis.

"Será que isso realmente se alinha com a nossa visão de educação?", questionou Heath, professor associado de design e tecnologia de aprendizagem na Universidade Loyola de Maryland. "Será que isso serve às comunidades, em vez de servir às pessoas que estão desenvolvendo essa tecnologia e nos dizendo que ela será transformadora?"

Budhai, professora associada de tecnologia educacional na Universidade de Delaware, afirmou que os programas de formação de professores devem incluir treinamento sobre como ajudar os alunos a examinar os efeitos da IA dentro e fora da sala de aula, incluindo seu impacto ambiental. Segundo ela, é necessário um tipo de alfabetização crítica em IA.

"Não estamos dizendo que precisamos ser contra a tecnologia", disse Budhai. "Estamos dizendo: vamos pensar nas questões mais amplas... Os alunos precisam desenvolver uma consciência crítica sobre as maneiras como interagimos com a IA e entender como ela funciona." Ela acrescentou: "Eles precisam realmente entender os malefícios que ela causa."

Os autores observaram que os educadores estão preocupados com a dependência excessiva dos alunos em relação à IA e seu possível impacto no pensamento crítico, na resolução de problemas e nos relacionamentos. A ameaça não se limita às habilidades que os alunos já desenvolveram, mas que podem perder ao terceirizar redações e outras tarefas para máquinas, afirmaram. O problema é muito mais profundo.

"Os alunos não sabem como escrever uma frase introdutória porque estão pedindo à IA para fazer isso", disse Budhai. "Eles estão ' nunca adquirindo habilidades ', o que é ainda mais assustador do que 'perder habilidades', que é perder as habilidades que tinham por dependerem demais da IA. 'Nunca adquirir habilidades' significa que eles nunca aprenderam a habilidade porque estão usando a IA para tudo, então eles nem sequer têm habilidades fundamentais."

Heath, um ex-professor de estudos sociais do ensino médio, preocupa-se com o impacto da IA nas interações sociais e na vida cívica.

"Penso em como essas tecnologias, particularmente a IA generativa , nos permitem realizar nossas atividades sem atritos, reduzindo assim a necessidade de interação humana", disse ela.

"Para que a democracia funcione, precisamos ser capazes de lidar com o desconforto e precisamos saber como é discordar e ser contestado. Uma das coisas que abdicamos quando recorremos a essa tecnologia é a capacidade de lidar com o desconforto e praticar o ato de estar desconfortável."

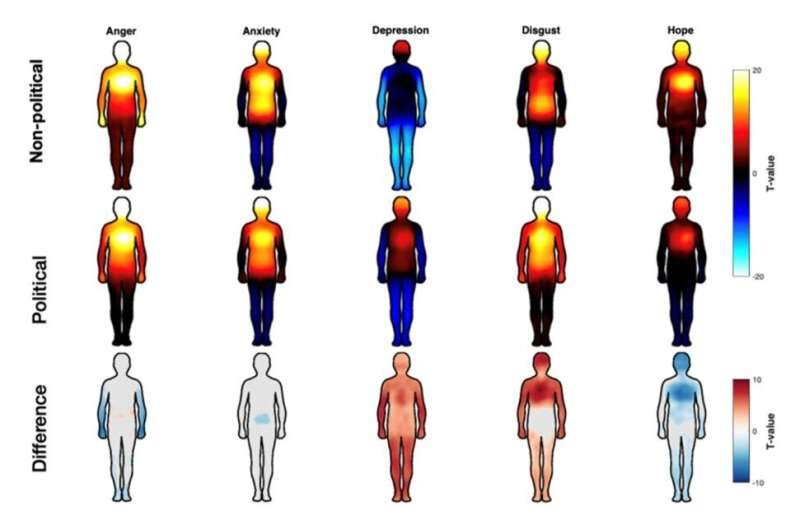

Os autores também se concentraram no problema dos vieses, explícitos e implícitos, nas ferramentas de IA. Ao pesquisarem "IA Crítica em Salas de Aula do Ensino Fundamental e Médio", eles pediram à IA recomendações de livros para estudantes negros e brancos do ensino médio e descobriram que as listas e até mesmo o feedback continham vieses implícitos, com os livros para estudantes negros sendo desproporcionalmente sobre crime e pobreza.

Em um projeto de pesquisa separado, Heath detectou vieses quando a IA fornecia feedback sobre os trabalhos escritos dos alunos.

"A IA está carregada de todos os preconceitos da sociedade", disse ela. "Se ela percebe que o aluno é de uma classe socioeconômica mais alta ou branco, o feedback que ela dá tem um tom muito coloquial, como: 'Você já pensou em XYZ?' Se a IA percebe que o aluno é socioeconomicamente desfavorecido ou é negro ou pardo, ela usa um tom muito direto e autoritário."

A mensagem da ferramenta, disse Heath, é: "'Eu sei o que é certo' e 'Você deve fazer isso desta maneira'."

Ao compartilhar as principais conclusões de suas descobertas, Budhai e Heath incentivaram os educadores a refletir sobre uma pergunta simples — por quê? — antes de implementar a IA na sala de aula.

"Para quem treina professores no uso da tecnologia, é fundamental ter uma estrutura em que, sempre que a tecnologia for usada, haja um propósito", disse Budhai. "Chamamos isso de 'uso intencional da tecnologia'. Eu pergunto aos alunos: 'Como isso ajuda a atingir os objetivos de aprendizagem?' Porque, se não estiver realmente funcionando, por que estamos usando?"

.jpg)