Tecnologia Científica

Padrões de segurança estratosféricos: como a aviação poderia orientar a regulamentação da IA na saúde

Uma equipe interdisciplinar de pesquisadores acredita que a IA em saúde poderia se beneficiar de algumas das lições duramente conquistadas pela indústria da aviação que criaram uma das atividades mais seguras da atualidade.

A IA tem potencial para melhorar muitos aspectos dos cuidados de saúde, desde a segurança do paciente até ao fluxo de trabalho do médico. A cultura de segurança da indústria da aviação poderia reduzir significativamente os riscos associados à implantação da IA na saúde. Créditos: Imagem: Adobe Stock

Qual é a probabilidade de morrer em um acidente de avião? De acordo com um relatório de 2022 divulgado pela Associação Internacional de Transporte Aéreo, o risco de fatalidade na indústria é de 0,11. Por outras palavras, em média, uma pessoa precisaria de apanhar um voo todos os dias durante 25.214 anos para ter 100% de probabilidade de sofrer um acidente fatal. Há muito apontado como um dos meios de transporte mais seguros, o altamente regulamentado setor da aviação fez com que os cientistas do MIT pensassem que pode ser a chave para regular a inteligência artificial nos cuidados de saúde.

Marzyeh Ghassemi, professora assistente do Departamento de Engenharia Elétrica e Ciência da Computação (EECS) do MIT e do Instituto de Ciências da Engenharia Médica, e Julie Shah, professora HN Slater de Aeronáutica e Astronáutica do MIT, compartilham interesse nos desafios da transparência em Modelos de IA. Depois de conversar no início de 2023, eles perceberam que a aviação poderia servir de modelo para garantir que pacientes marginalizados não fossem prejudicados por modelos tendenciosos de IA.

Ghassemi, que também é pesquisador principal da Clínica Abdul Latif Jameel do MIT para Aprendizado de Máquina em Saúde (Clínica Jameel) e do Laboratório de Ciência da Computação e Inteligência Artificial (CSAIL), e Shah recrutaram então uma equipe interdisciplinar de pesquisadores, advogados, e analistas de políticas do MIT, da Universidade de Stanford, da Federação de Cientistas Americanos, da Universidade Emory, da Universidade de Adelaide, da Microsoft e da Universidade da Califórnia em São Francisco para iniciar um projeto de pesquisa, cujos resultados foram recentemente aceitos no Equity and Access na Conferência sobre Algoritmos, Mecanismos e Otimização.

“Acho que muitos de nossos coautores estão entusiasmados com o potencial da IA para impactos sociais positivos, especialmente com os avanços recentes”, diz a primeira autora Elizabeth Bondi-Kelly, agora professora assistente de EECS na Universidade de Michigan, que fez pós-doutorado no laboratório de Ghassemi quando o projeto começou. “Mas também somos cautelosos e esperamos desenvolver estruturas para gerenciar riscos potenciais à medida que as implantações começarem a acontecer, por isso estávamos buscando inspiração para tais estruturas.”

A IA na saúde hoje tem uma semelhança com a indústria da aviação há um século, diz a coautora Lindsay Sanneman, estudante de doutorado no Departamento de Aeronáutica e Astronáutica do MIT. Embora a década de 1920 fosse conhecida como“ a Era de Ouro da Aviação”, os acidentes fatais foram “perturbadoramente numerosos”, de acordo com o Centro Mackinac de Políticas Públicas.

Jeff Marcus, o atual chefe da Divisão de Recomendações de Segurança do National Transportation Safety Board (NTSB), publicou recentemente uma postagem no blog do Mês Nacional da Aviação observando que, embora vários acidentes fatais tenham ocorrido na década de 1920, 1929 continua sendo o “pior ano já registrado” para os acidentes de aviação mais fatais da história, com 51 acidentes relatados. Pelos padrões atuais, seriam 7.000 acidentes por ano, ou 20 por dia. Em resposta ao elevado número de acidentes fatais na década de 1920, o presidente Calvin Coolidge aprovou uma legislação histórica em 1926, conhecida como Lei do Comércio Aéreo, que regularia as viagens aéreas através do Departamento de Comércio.

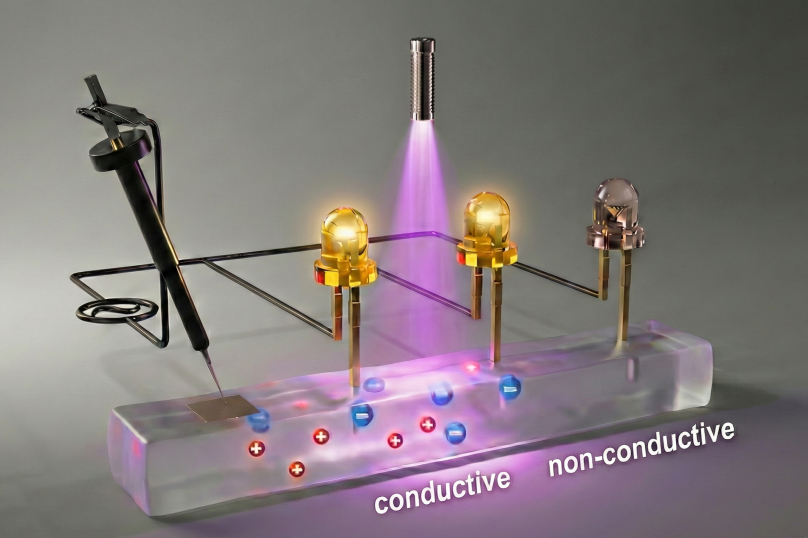

Mas os paralelos não param por aí – o caminho subsequente da aviação para a automação é semelhante ao da IA. A explicabilidade da IA tem sido um tópico controverso devido ao notório problema da “caixa preta” da IA, que faz com que os investigadores de IA debatam o quanto um modelo de IA deve “explicar” o seu resultado ao utilizador antes de potencialmente induzi-lo a seguir cegamente a orientação do modelo.

“Na década de 1970, havia uma quantidade crescente de automação... sistemas de piloto automático que alertavam os pilotos sobre os riscos”, acrescenta Sanneman. “Houve algumas dificuldades crescentes à medida que a automação entrou no espaço da aviação em termos de interação humana com o sistema autônomo – confusão potencial que surge quando o piloto não tem uma consciência aguçada sobre o que a automação está fazendo.”

Hoje, tornar-se capitão de uma companhia aérea comercial requer 1.500 horas de voo registrado, juntamente com treinamento em instrumentos. Segundo o artigo dos pesquisadores , esse processo rigoroso e abrangente leva aproximadamente 15 anos, incluindo o bacharelado e a copilotagem. Os pesquisadores acreditam que o sucesso do treinamento extensivo de pilotos pode ser um modelo potencial para treinar médicos no uso de ferramentas de IA em ambientes clínicos.

O documento também propõe relatórios encorajadores sobre ferramentas de IA para a saúde inseguras, tal como a Agência Federal de Aviação (FAA) faz com os pilotos – através de “imunidade limitada”, que permite aos pilotos manterem a sua licença após fazerem algo inseguro, desde que não seja intencional.

De acordo com um relatório de 2023 publicado pela Organização Mundial de Saúde, em média, um em cada 10 pacientes é prejudicado por um evento adverso (ou seja, “erros médicos”) enquanto recebe cuidados hospitalares em países de rendimento elevado.

No entanto, na prática atual dos cuidados de saúde, os médicos e os profissionais de saúde muitas vezes temem denunciar erros médicos, não só por causa de preocupações relacionadas com a culpa e a autocrítica, mas também devido às consequências negativas que enfatizam a punição dos indivíduos, tais como uma licença médica revogada, em vez de reformar o sistema que aumentava a probabilidade de ocorrência de erros médicos.

“Na saúde, quando o martelo falha, os pacientes sofrem”, escreveu Ghassemi num comentário recente publicado na Nature Human Behavior . “Esta realidade apresenta um risco ético inaceitável para as comunidades de IA médica que já se debatem com questões complexas de cuidados, escassez de pessoal e sistemas sobrecarregados.”

Grace Wickerson, coautora e gestora de políticas de igualdade na saúde da Federação de Cientistas Americanos, vê este novo artigo como um acréscimo crítico a um quadro de governação mais amplo que ainda não está em vigor. “Acho que podemos fazer muito com a autoridade governamental existente”, dizem eles. “Existem diferentes maneiras pelas quais o Medicare e o Medicaid podem pagar pela IA de saúde que garante que a equidade seja considerada em suas tecnologias de compra ou reembolso. O NIH [Instituto Nacional de Saúde] pode financiar mais pesquisas para tornar algoritmos mais equitativos e construir padrões para esses algoritmos isso poderia então ser usado pela FDA [Food and Drug Administration] enquanto eles tentam descobrir o que significa igualdade na saúde e como são regulamentados dentro de suas autoridades atuais”.

Entre outros, o artigo lista seis principais agências governamentais existentes que poderiam ajudar a regular a IA em saúde, incluindo: a FDA, a Federal Trade Commission (FTC), a recentemente criada Agência de Projetos de Pesquisa Avançada para Saúde, a Agência de Pesquisa e Qualidade em Saúde, a Centros de Medicare e Medicaid, o Departamento de Saúde e Serviços Humanos e o Escritório de Direitos Civis (OCR).

Mas Wickerson diz que é preciso fazer mais. A parte mais desafiadora da redação do artigo, na opinião de Wickerson, foi “imaginar o que ainda não temos”.

Em vez de depender apenas dos organismos reguladores existentes, o documento também propõe a criação de uma autoridade de auditoria independente, semelhante ao NTSB, que permite uma auditoria de segurança para sistemas de IA de saúde com mau funcionamento.

“Acho que essa é a questão atual para a governança tecnológica – não temos realmente uma entidade que avalie o impacto da tecnologia desde os anos 90”, acrescenta Wickerson. “Havia um Escritório de Avaliação Tecnológica... antes mesmo de a era digital começar, esse escritório existia e então o governo federal permitiu que ele fosse extinto.”

Zach Harned, coautor e recém-formado pela Faculdade de Direito de Stanford, acredita que o principal desafio da tecnologia emergente é fazer com que o desenvolvimento tecnológico ultrapasse a regulamentação. “No entanto, a importância da tecnologia de IA e os potenciais benefícios e riscos que ela representa, especialmente na área dos cuidados de saúde, levaram a uma enxurrada de esforços regulatórios”, diz Harned. “A FDA é claramente o principal ator aqui e tem emitido consistentemente orientações e white papers tentando ilustrar sua posição em evolução em relação à IA; no entanto, a privacidade será outra área importante a ser observada, com a aplicação do OCR no lado da HIPAA [Lei de Responsabilidade e Portabilidade de Seguros de Saúde] e a FTC aplicando violações de privacidade para entidades não cobertas pela HIPAA.”

Harned observa que a área está evoluindo rapidamente, incluindo desenvolvimentos como a recente Ordem Executiva 14110 da Casa Branca sobre o desenvolvimento seguro e confiável da IA, bem como a atividade regulatória na União Europeia (UE), incluindo a Lei de IA da UE que é quase finalização. “É certamente um momento emocionante para ver esta importante tecnologia ser desenvolvida e regulamentada para garantir a segurança e, ao mesmo tempo, não sufocar a inovação”, diz ele.

Além das atividades regulatórias, o documento sugere outras oportunidades para criar incentivos para ferramentas de IA de saúde mais seguras, como um programa de pagamento por desempenho, no qual as companhias de seguros recompensam os hospitais pelo bom desempenho (embora os investigadores reconheçam que esta abordagem exigiria supervisão adicional para seja equitativo).

Então, quanto tempo os pesquisadores acham que levaria para criar um sistema regulatório funcional para a IA em saúde? Segundo o jornal, “o sistema NTSB e FAA, onde as investigações e a fiscalização são realizadas em dois órgãos diferentes, foi criado pelo Congresso ao longo de décadas”.

Bondi-Kelly espera que o artigo seja uma peça do quebra-cabeça da regulamentação da IA. Na sua opinião, “o cenário dos sonhos seria que todos nós lêssemos o artigo e nos sentíssemos inspirados a aplicar algumas das lições úteis da aviação para ajudar a IA a prevenir alguns dos potenciais danos da IA ??durante a implantação”.

Além de Ghassemi, Shah, Bondi-Kelly e Sanneman, os coautores do trabalho do MIT incluem o cientista pesquisador sênior Leo Anthony Celi e os ex-pós-doutorandos Thomas Hartvigsen e Swami Sankaranarayanan. O financiamento para o trabalho veio, em parte, de uma bolsa MIT CSAIL METEOR, da Quanta Computing, da Fundação Volkswagen, dos Institutos Nacionais de Saúde, da cátedra de desenvolvimento de carreira Herman LF von Helmholtz e de um prêmio CIFAR Azrieli Global Scholar.