Tecnologia Científica

Uma maneira mais rápida de estimar o consumo de energia da IA

O método “EnergAIzer” gera resultados confiáveis ??em segundos, permitindo que os operadores de data centers aloquem recursos de forma eficiente e reduzam o desperdício de energia.

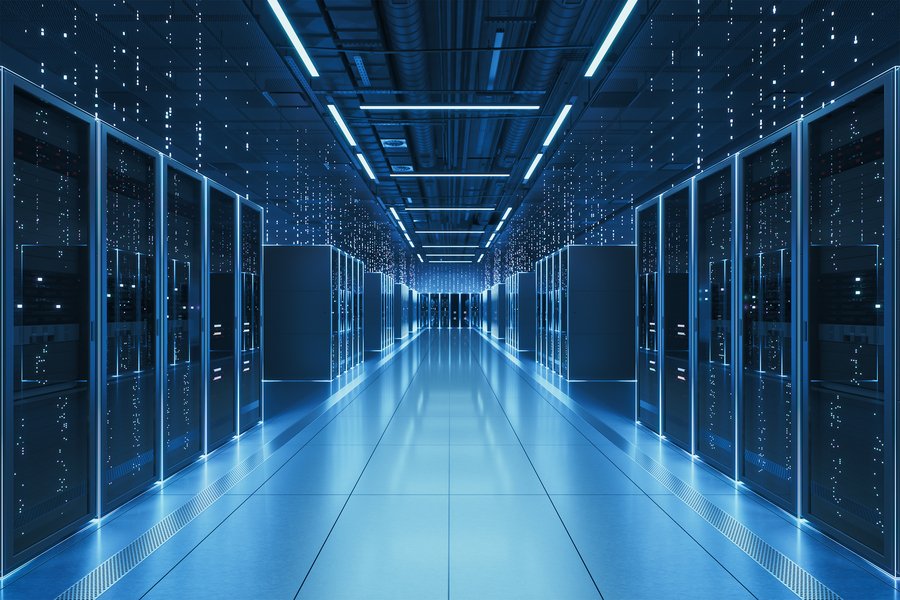

Pesquisadores do MIT e do MIT-IBM Watson AI Lab desenvolveram uma ferramenta que prevê o consumo de energia de cargas de trabalho de IA, ajudando os centros de dados a alocar recursos de forma eficiente e a reduzir o desperdício de energia. Crédito: iStock

Devido ao crescimento exponencial da inteligência artificial, estima-se que os centros de dados consumirão até 12% da eletricidade total dos EUA até 2028 , segundo o Laboratório Nacional Lawrence Berkeley. Melhorar a eficiência energética dos centros de dados é uma das maneiras pelas quais os cientistas estão se esforçando para tornar a IA mais sustentável.

Com esse objetivo em mente, pesquisadores do MIT e do MIT-IBM Watson AI Lab desenvolveram uma ferramenta de previsão rápida que informa aos operadores de data centers quanta energia será consumida ao executar uma determinada carga de trabalho de IA em um determinado processador ou chip acelerador de IA.

O método deles produz estimativas de consumo de energia confiáveis em poucos segundos, ao contrário das técnicas de modelagem tradicionais que podem levar horas ou até dias para apresentar resultados. Além disso, a ferramenta de previsão pode ser aplicada a uma ampla gama de configurações de hardware — inclusive projetos emergentes que ainda não foram implementados.

Os operadores de data centers poderiam usar essas estimativas para alocar recursos limitados de forma eficaz entre vários modelos e processadores de IA, melhorando a eficiência energética. Além disso, essa ferramenta poderia permitir que desenvolvedores de algoritmos e fornecedores de modelos avaliassem o consumo potencial de energia de um novo modelo antes de sua implementação.

“O desafio da sustentabilidade da IA é uma questão urgente que precisamos responder. Como nosso método de estimativa é rápido, conveniente e fornece feedback direto, esperamos que ele incentive os desenvolvedores de algoritmos e os operadores de data centers a pensarem mais em reduzir o consumo de energia”, afirma Kyungmi Lee, pós-doutoranda do MIT e autora principal de um artigo sobre essa técnica .

Ela é acompanhada no artigo por Zhiye Song, estudante de pós-graduação em engenharia elétrica e ciência da computação (EECS); Eun Kyung Lee e Xin Zhang, gerentes de pesquisa da IBM Research e do Laboratório de IA Watson MIT-IBM; Tamar Eilam, IBM Fellow, cientista-chefe de computação sustentável da IBM Research e membro do Laboratório de IA Watson MIT-IBM; e o autor sênior Anantha P. Chandrakasan, reitor do MIT, professor titular da Cátedra Vannevar Bush de Engenharia Elétrica e Ciência da Computação e membro do Laboratório de IA Watson MIT-IBM. A pesquisa está sendo apresentada esta semana no Simpósio Internacional IEEE sobre Análise de Desempenho de Sistemas e Software.

Acelerar a estimativa de energia

Dentro de um centro de dados, milhares de unidades de processamento gráfico (GPUs) de alto desempenho executam operações para treinar e implantar modelos de IA. O consumo de energia de uma GPU específica varia de acordo com sua configuração e a carga de trabalho que está sendo processada.

Muitos métodos tradicionais usados para prever o consumo de energia envolvem dividir uma carga de trabalho em etapas individuais e emular como cada módulo dentro da GPU está sendo utilizado, uma etapa de cada vez. Mas cargas de trabalho de IA, como treinamento de modelos e pré-processamento de dados, são extremamente grandes e podem levar horas ou até dias para serem simuladas dessa maneira.

“Como operador, se eu quiser comparar diferentes algoritmos ou configurações para encontrar a maneira mais eficiente em termos de energia de proceder, se uma única emulação levar dias, isso se tornará muito impraticável”, diz Lee.

Para acelerar o processo de previsão, os pesquisadores do MIT buscaram usar informações menos detalhadas que pudessem ser estimadas mais rapidamente. Eles descobriram que as cargas de trabalho de IA frequentemente apresentam muitos padrões repetíveis. Esses padrões poderiam ser usados para gerar as informações necessárias para uma estimativa de potência confiável e rápida.

Em muitos casos, os desenvolvedores de algoritmos escrevem programas para serem executados da forma mais eficiente possível em uma GPU. Por exemplo, eles usam otimizações bem estruturadas para distribuir o trabalho entre os núcleos de processamento paralelo e mover blocos de dados da maneira mais eficiente.

“Essas otimizações que os desenvolvedores de software usam criam uma estrutura regular, e é isso que estamos tentando aproveitar”, explica Lee.

Os pesquisadores desenvolveram um modelo de estimativa leve, chamado EnergAIzer, que captura o padrão de consumo de energia de uma GPU a partir dessas otimizações.

Uma avaliação precisa

Mas, embora a estimativa tenha sido rápida, os pesquisadores descobriram que ela não levava em consideração todos os custos de energia. Por exemplo, cada vez que uma GPU executa um programa, há um custo fixo de energia necessário para configurar e inicializar esse programa. Além disso, cada vez que a GPU executa uma operação em um bloco de dados, um custo adicional de energia deve ser pago.

Devido a flutuações no hardware ou conflitos no acesso ou na transferência de dados, uma GPU pode não conseguir utilizar toda a largura de banda disponível, o que torna as operações mais lentas e consome mais energia ao longo do tempo.

Para incluir esses custos e variações adicionais, os pesquisadores coletaram medições reais de GPUs para gerar termos de correção que aplicaram ao seu modelo de estimativa.

“Dessa forma, podemos obter uma estimativa rápida e muito precisa”, diz ela.

Por fim, o usuário pode fornecer informações sobre sua carga de trabalho, como o modelo de IA que deseja executar e o número e extensão das entradas do usuário a serem processadas, e o EnergAIzer gerará uma estimativa de consumo de energia em questão de segundos.

O usuário também pode alterar a configuração da GPU ou ajustar a velocidade de operação para ver como essas escolhas de design impactam o consumo geral de energia.

Quando os pesquisadores testaram o EnergAIzer usando informações reais de cargas de trabalho de IA de GPUs reais, ele conseguiu estimar o consumo de energia com um erro de apenas cerca de 8%, o que é comparável aos métodos tradicionais que podem levar horas para produzir resultados.

O método deles também poderia ser usado para prever o consumo de energia de GPUs futuras e configurações de dispositivos emergentes, desde que o hardware não mude drasticamente em um curto período de tempo.

No futuro, os pesquisadores pretendem testar o EnergAIzer nas configurações de GPU mais recentes e ampliar o modelo para que possa ser aplicado a várias GPUs que estejam colaborando para executar uma carga de trabalho.

“Para realmente causar um impacto na sustentabilidade, precisamos de uma ferramenta que possa fornecer uma solução rápida de estimativa de energia em toda a cadeia de valor, para projetistas de hardware, operadores de data centers e desenvolvedores de algoritmos, para que todos possam estar mais cientes do consumo de energia. Com esta ferramenta, demos um passo em direção a esse objetivo”, diz Lee.

Esta pesquisa foi financiada, em parte, pelo MIT-IBM Watson AI Lab.